※ 本記事は、Henry Jerez, Christian Linacreによる”Announcing New AI Infrastructure Capabilities with NVIDIA Blackwell for Public, On-Premises, and Service Provider Clouds“を翻訳したものです。

2025年5月8日

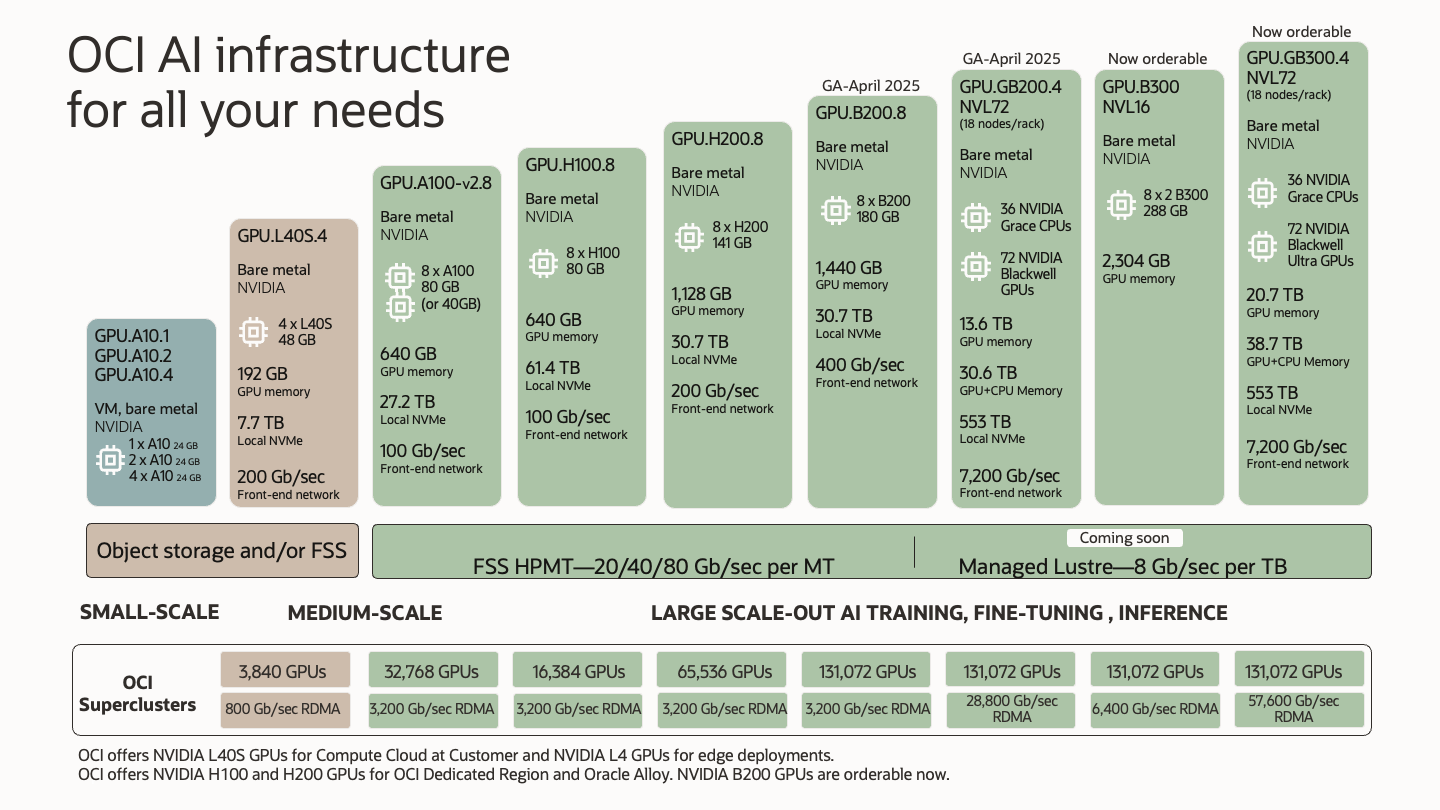

Oracle Cloud Infrastructure (OCI)では、必要な場所で、AIワークロードに最も高度なクラウド・インフラストラクチャをお客様に提供することを約束します。大規模なマルチモーダル・モデルのトレーニング、大規模言語モデル(LLM)のファインチューニング、大規模なリアルタイム推論の導入など、当社のAIインフラストラクチャは、市場で最も強力なGPUを使用して最も要求の厳しいワークロードを処理するように構築されています。

今日、パブリック・クラウド、OCI Dedicated Region、Oracle Alloyの新しいAIインフラストラクチャ機能を発表できることを嬉しく思います。これらの製品は、単一のインスタンスから数千ものGPUを持つクラスタまで、あらゆる規模の最新のNVIDIA BlackwellアーキテクチャのGPUおよびスーパーチップを提供します。

オラクルは、次世代のNVIDIA GB300 NVL72およびNVIDIA HGX B300 NVL16にBlackwell Ultra GPUを搭載したオーダビリティを提供する最初のクラウド・サービス・プロバイダーであり、AIアクセラレーションへの早期アクセスを提供します。次の製品をお知らせします:

オーダー可能(今年後半に使用可能):

-

NVIDIA GB300 Grace Blackwell Ultra Superchipsを搭載したOCI Computeベア・メタル

-

NVIDIA B300 Blackwell Ultra GPUを搭載したOCI Computeベア・メタル

-

NVIDIA ConnectX®-8 SuperNICs™ を搭載したラックスケールのNVIDIA GB300 NVL72ソリューションの一部として、最大131,072 NVIDIA GB300 Grace Blackwell Ultra Superchipsを搭載したOCI Supercluster

-

NVIDIA ConnectX-8 SuperNICsを搭載したNVIDIA HGX B300 NVL16ソリューションの一部として最大131,072のNVIDIA Blackwell Ultra GPUを搭載したOCI Supercluster

-

NVIDIA Blackwell GPUを搭載したOCI Computeベア・メタル (OCI Dedicated RegionおよびOracle Alloy)

提供開始:

-

NVIDIA Hopper GPUを搭載したOCI Computeベア・メタル (OCI Dedicated RegionおよびOracle Alloy)

2025年4月に提供開始:

-

NVIDIA GB200 Grace Blackwell Superchipsを搭載したOCI Computeベア・メタル

-

NVIDIA Blackwell GPUを搭載したOCI Computeベア・メタル

-

ラックスケールのNVIDIA GB200 NVL72ソリューションの一部として最大131,072 NVIDIA GB200 Grace Blackwell Superchipsを搭載したOCI Supercluster

-

最大131,072のNVIDIA Blackwell GPUを搭載したOCI Supercluster

ベア・メタルAIコンピュートの最も広範なポートフォリオの拡大

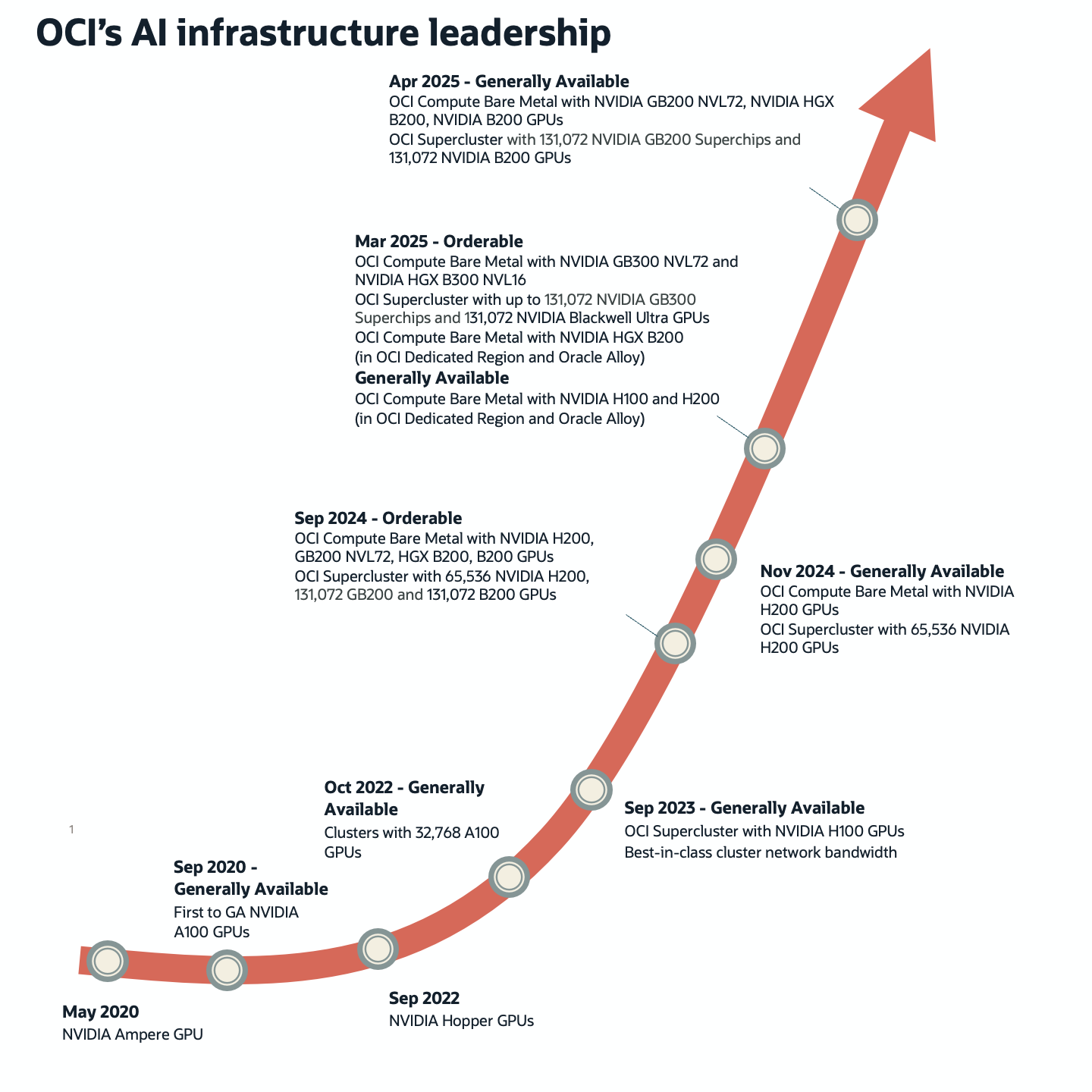

OCIは、AIインフラストラクチャのイノベーションの最前線にいます。2016年、Oracleはベア・メタル・インスタンスを導入した最初の主要なクラウド・プロバイダになりました。2020年には、NVIDIA A100 GPUの一般提供を初めて実現しました。それ以来、私たちはシリコン・パートナーから最新のAIコンピューティングイノベーションを継続的に提供し、AIの限界を押し広げてきました。オラクルのAIインフラストラクチャのジャーニーと、長年にわたるOCIのAIコンピューティング製品の急速な成長をご覧ください。

今日の発表により、OCIはパブリック・クラウド・リージョン、OCI Dedicated Region、Oracle Alloy全体で、ベア・メタルAIコンピュートの最も広範なラインナップを提供しています。

かつてない拡張性と柔軟性を備えたAIインフラストラクチャ

AIワークロードは万能ではありません。多くの組織では、厳格なデータ・ソブリン、セキュリティ、規制要件に沿ったインフラストラクチャが必要です。OCI Dedicated Regionは、わずか3ラックから拡張可能なフットプリントを実現し、お客様のデータ・センターに事前構成されたモジュラー・インフラストラクチャを提供します。Oracle Alloyは、完全なクラウド・インフラストラクチャ・プラットフォームです。パートナーは、ビジネス・モデルを変革して、自社のクラウド・プロバイダーとなり、150を超えるOCIクラウド・サービスを自社の顧客に提供することができます。

NVIDIA Hopper GPUを搭載したOCI Computeの一般提供と、OCI Dedicated RegionおよびOracle Alloy向けのNVIDIA Blackwell GPUを搭載したOCI Computeのオーダビリティにより、最先端のアクセスを実現GPUコンピューティングをデータ・センターに直接組み込み、AIトレーニング、推論、ファインチューニング用のカスタムおよびオープン・ソース・モデルを構築および導入したり、NVIDIA GPUとNVIDIA cuVSを搭載したデータベースのベクトル検索を生成したりします。Oracle Fusion ERPの財務管理の予測的インサイトや、Oracle Fusion HCMの採用マネージャ向けのコンテンツ生成など、Fusion AI applicationsにはOCI生成AIサービスまたはエージェントAI機能を使用できます。

小規模な推論とトレーニングのために、RDMAクラスタ・ネットワーキングの有無にかかわらず、小規模なGPUを8つまで起動し、クラスタごとに最大64のGPUまで拡張できます。64個のGPUのクラスタを複数持つことも、大規模なAIインフラストラクチャ導入のために1,024以上のGPUのクラスタを選択することもできます。いつものように、Oracleの分散クラウドのどこでも同じ運用支出(OpEx)の柔軟性が得られます。この発表ブログ記事では、Oracle分散クラウド・ソブリンAI機能について詳しく説明します。

あらゆるワークロードに対応した最もスケーラブルなAIインフラストラクチャ

GB200 NVL72のような単一のNVIDIA GPUラックスケール・ソリューションを導入する場合でも、クラウドで最大のAI Superclusterを運用する場合でも、OCIはAIドリブンのイノベーションをあらゆる規模で実現できるようにします。次の最近の発表から、オラクルにお問い合せください。オンラインにアクセスし、Oracle Cloud Infrastructureの詳細を確認してください:

- First Principles(第一原則): 次世代AIのためのゼタスケールのOCIスーパークラスタ内部

- OracleとNVIDIAがどこにでもソブリンAIを提供

- OCI AI Blueprints: OCIへのAIワークロードの導入時にゼロからヒーローへ

- Oracle、NVIDIA AI EnterpriseとOCIを統合し、エンタープライズにおけるイノベーションを推進

- NVIDIA GPU Device Plugin Add-On for OKE 提供開始の発表

- NVIDIA GPUによるOracle Database 23aiでのAI Vector Searchの高速化

- DeweyVision Transforms Media Discovery with Oracle AI Vector Search: Faster, Smarter, and More Cost-Effective

- Beyond Structured Data: The AI Revolution in Market Data Analytics

詳細は、次のリソースを参照してください: