※ 本記事は、Albert Barajasによる”Accelerate your real time AI inference and graphics intensive workloads with the Nvidia A10 Tensor Core GPU and NVIDIA RTX Virtual Workstations“を翻訳したものです。

2022年10月21日

NVIDIA Ampere A10 Tensor Core GPUを搭載したOracle Cloud Infrastructure GU1インスタンスと、プログラフィックス用のRTXの発売を発表できることを嬉しく思います。各GPUに24GBのGPUメモリーを搭載したOCI GU1インスタンスは、計算機能とエンコーダ/デコーダ機能の両方を、グラフィックス集中型およびAIワークロードをサポートするのに十分な柔軟性を備えたコンパクトな低電力フォームファクタで提供します。グローバル・リージョン全体でベア・メタルとVMシェイプの両方で提供されます。NVIDIA RTX vWSは、NVIDIA RTXテクノロジーをサポートする唯一の仮想ワークステーションであり、レイ・トレース、AI-Denoising、Deep Learning Super Sampling(DLSS)などの高度な機能をクラウドベースの仮想環境に導入しています。最新世代のNVIDIA GPUをサポートすることで、可能な限り最高のパフォーマンスが得られるため、設計者とエンジニアは最高の作業をより迅速に作成できます。

グラフィックスとAIの両方に1つのGPU

NVIDIA A10 GPUは、最もグラフィックスを多用するアプリケーションや機械学習推論ワークロード向けに設計されており、さらに単純な機械学習モデルや中程度の機械学習モデルのトレーニングも可能です。

グラフィックのワークロード

NVIDIA RTX Virtual Workstation(vWS)ソフトウェアをA10 GPUとともに使用すると、インタラクティブなビデオ・レンダリング、ビデオ編集、コンピュータ支援設計、フォトリアリスティック・シミュレーション、3Dビジュアライゼーション、仮想デスクトップ・インフラストラクチャ(VDI)、クラウド・ゲームなどの幅広いグラフィックス・アプリケーションを高速化できます。A10内の2世代目のRTコアでは、レイトレースモーションブラーのレンダリングが高速化され、視覚精度が向上します。NVIDIA RTX vWSは、24GBのGDDR6メモリと600GB/sのメモリ帯域幅と組み合わせることで、グラフィックス集約型のワークロードに必要なパフォーマンスを実現し、クリエイティブで技術的なプロフェッショナルをサポートします。

A10 GPUを搭載したNVIDIA RTX vWSには、ビデオ・ストリーミングやクラウド・ゲーム・ワークロードに最適なエンコーダ/デコーダ・ハードウェアも追加されています。

機械学習ワークロード

機械学習の場合、A10 GPUは、音声アシスタント、チャットボット、ビジュアル検索などの用途向けに、リアルタイムのAI推論パフォーマンスを大規模に提供します。ディープ・ラーニング・スーパー・サンプリング(DLSS)などのTensor Core機能により、選択したアプリケーションのグラフィック編集が向上します。これらのワークロードの多様なニーズをサポートするために、最新世代のIntel Xeon Ice Lake CPUの64コア、1TBのシステム・メモリー、およびデータをキャッシュするための7.68TBの低レイテンシのNVMeローカル・ストレージでA10 GPUを組み合わせました。

また、NVIDIA Ampere A100 Tensor Core GPUに基づく強力なBM.GPU.GM4.8インスタンスも提供しています。これは、大規模なモデルのトレーニングや大規模なデータセットの処理に最適です。ただし、中小規模のAIワークロードの場合、OCI GU1インスタンスはパフォーマンスの最適なバランスを提供し、お客様が必要とする機能を柔軟なフォーム・ファクタで提供します。

最適化された価格 / パフォーマンス

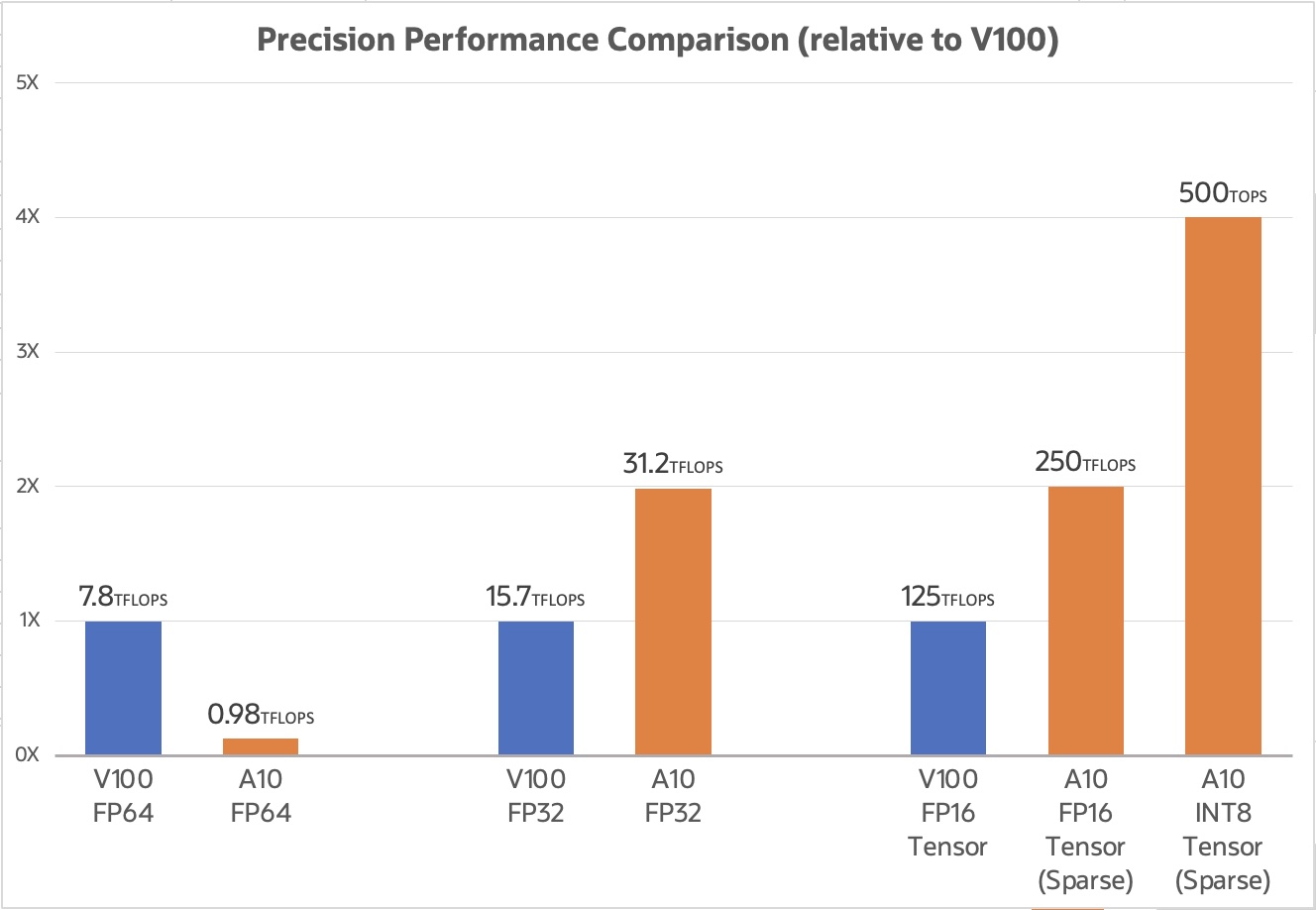

NVIDIA Ampere世代のTensor CoreテクノロジとA10の小さいフォーム・ファクタを組み合せると、お客様はより低いコストでより優れたパフォーマンスを得ることができます。前世代のGPU3インスタンスで使用されていたNVIDIA V100 GPUと比較して、A10はほとんどのAIワークロードで最大4倍のパフォーマンス(特にスパリティ)を実現し、リスト価格(GPU3の場合は1時間当たり2.95ドル、G1の場合は1時間当たり2ドル)に基づいてコストを32%削減できます。V100 GPUは、倍精度(FP64)のパフォーマンスを必要とする高パフォーマンス・コンピューティング・ワークロードに適しています。

GPU GU1シェイプ

OCIのGU1インスタンスは、最大限のパフォーマンスを発揮するためにベア・メタル・サーバーとして使用可能になり、VMシェイプ(近日提供)によってあらゆる規模のワークロードに対応できる柔軟性が向上します。OCIのGU1インスタンスは、グローバル・リージョン全体で1時間あたりGPUあたりUS$2で価格設定されているため、より一貫性のあるコスト効率の高い方法で顧客ワークロードに対応できます。主な技術仕様は次のとおりです。:

| GPU | GPUメモリー | CPU | システム・メモリー | ストレージ | ネットワーク | 時間あたりのリスト価格 | |

|---|---|---|---|---|---|---|---|

| BM.GPU.GU1.4 | 4x NVIDIA A10 | 96 GB | 2x32core Intel 8358 2.6Ghz base 3.4Ghz Turbo | 1 TB DDR4 | 2×3.84TB NVMeUpto 1 PB Block Storage | 2×50 Gbps | $8.00 |

| *VM.GPU.GU1.1 | 1x NVIDIA A10 | 24 GB | 15 core Intel 8358 2.6Ghz base 3.4Ghz Turbo | 240 GB DDR4 | Upto 1 PB Block Storage | 24 Gbps | $2.00 |

| *VM.GPU.GU1.2 | 2x NVIDIA A10 | 48 GB | 30 core Intel 8358 2.6Ghz base 3.4Ghz Turbo | 480 GB DDR4 | Upto 1 PB Block Storage | 48 Gbps | $4.00 |

* VMシェイプは近日提供

幅広い可用性

OCIのGU1インスタンスは、開始時に11のリージョン間で使用できます。:

- United States: US East (Ashburn), US West (Phoenix), US West (San Jose), Canada Southeast (Toronto)

- Europe and Middle East: UK South (London), Germany Central (Frankfurt), France Central (Paris), Saudi Arabia West (Jeddah)

- Asia Pacific: Japan East (東京), Japan Central (大阪), Singapore (Singapore)

はじめに

OIC GU1インスタンスの仕様、価格設定および可用性の詳細は、オラクルのドキュメントを参照してください。Oracle Cloud Infrastructureの機能についてさらに学習するには、開始するために次のリソース(OCI GPUs for AI innovators、Oracle AI、OCI Compute)を参照してください。

NVIDIA A10 GPUを追加すると、NVIDIA GPUの既存のラインだけでなく、Oracle Cloud Infrastructure上の世界中のスタートアップ、企業、政府向けのコンピューティングの新時代が始まります。すべてのワークロードが同じであるとは限りません。また、最新世代のGPUハードウェアで最適に動作するためにカスタマイズが必要な場合もあります。Oracle Cloudでは、ワークロードを稼働させるためのテクニカル・サポートを提供しています。詳細については、営業担当者にお問い合せください。